- ◆ 支持核心

- CatServer,Spigot,PaperSpigot,Magma,Arclight

- ◆ 插件前置

- AyCore

- ◆ 游戏版本

- 1.12.2-1.20.2

此插件一时兴起写的,更新随缘,

但已开源,有能力的服主可自行修改

开源地址:https://github.com/blank038/OllamaChat

一、命令

/ollama gen <问题> 进行对话

/ollama reload 重载配置文件

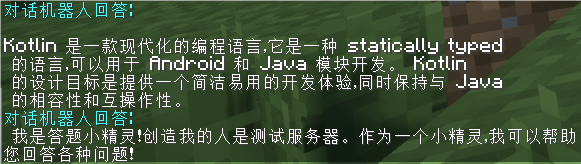

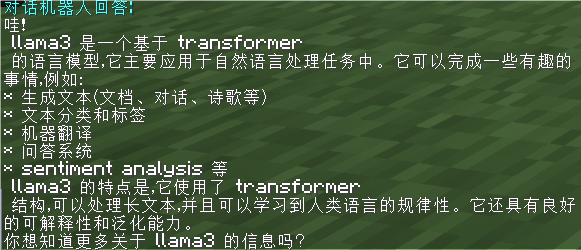

二、截图

三、接口

消息处理接口,自定义消息需实现 IMessage 接口,默认提供 NormalMessage

四、使用方法 & 自行安装 ollama: https://ollama.com/

PowerShell

PowerShell

Bash

Bash

如果你是本地跑的模型,就不需要修改 host,否则需要修改 config.yml 内的 hosts 配置。

但已开源,有能力的服主可自行修改

开源地址:https://github.com/blank038/OllamaChat

一、命令

/ollama gen <问题> 进行对话

/ollama reload 重载配置文件

二、截图

三、接口

消息处理接口,自定义消息需实现 IMessage 接口,默认提供 NormalMessage

代码:

OllamaChatApi.generate(host, model, prompt, messageConsumer, errorConsumer)四、使用方法 & 自行安装 ollama: https://ollama.com/

代码:

$Env:OLLAMA_ORIGINS="*" ; ollama serve ; ollama run <模型名, 例如 llama3>

Bash:

export OLLAMA_ORIGINS="*" && ollama serve && ollama run <模型名, 例如 llama3>如果你是本地跑的模型,就不需要修改 host,否则需要修改 config.yml 内的 hosts 配置。